‘Ik moet maar eens op gaan letten wat ik tweet’, is een veelgehoorde reactie wanneer ik anderen vertel over mijn onderzoek naar het verwerken van tweets met de computer. Associaties met de NSA zijn snel gemaakt. Privacy is een van de belangrijkste ethische kwesties waar de taaltechnologie mee te kampen heeft.

De NSA (of soortgelijke organisaties in andere landen dan Amerika) heeft tot doel om de veiligheid van de natie te bewaken. Een van de manieren om dit te doen, is communicatiestromen onderscheppen en verdachte uitingen te signaleren. Met een groot visnet worden gigantische aantallen (al dan niet persoonlijke) boodschappen van het Web binnengehaald. Deze kunnen nooit allemaal door de mensen van de NSA gelezen worden, en dat is waar taaltechnologie komt kijken. Daarmee kunnen taaluitingen automatisch geïnterpreteerd worden, zodat men direct kan inzoomen op conversaties die de computer als verdacht classificeert.

Filteren

Dat taaltechnologen in de wetenschap niet de veiligheid van de natie als prioriteit nummer 1 hebben, zal geen verrassing zijn. Toch lopen de technieken nauwelijks uiteen. Ook veel wetenschappers zijn in het tijdperk van social media geïnteresseerd in het in kaart brengen van het grote plaatje achter de stroom aan berichten, of het kunnen inzoomen op belangwekkende patronen, zoals cyberbullying of zelfmoordberichten. Zelf heb ik me met collega’s bijvoorbeeld gericht op het automatisch detecteren van sarcasme in tweets. Dit kwam met name voort uit interesse naar de manieren waarop mensen sarcasme overbrengen op dit medium. De NSA blijkt ook geïnteresseerd in de automatische detectie van sarcasme, maar dan om niet letterlijk bedoelde boodschappen weg te kunnen filteren.

Verantwoordelijkheid

De praktijken van de NSA en taaltechnologen in de wetenschap lopen dus behoorlijk parallel. Verschil is wel dat wetenschappers zich puur op legaal terrein bewegen. Tweets zijn bijvoorbeeld een populair domein van onderzoek, omdat dit platform een heel open karakter heeft. We gaan niet willekeurige email accounts hacken om maar meer data te kunnen onderzoeken. Toch pleit dat ons niet vrij van de verantwoordelijkheid om te reflecteren op de technieken die we ontwikkelen en hun mogelijke toepassingen.

Privacy

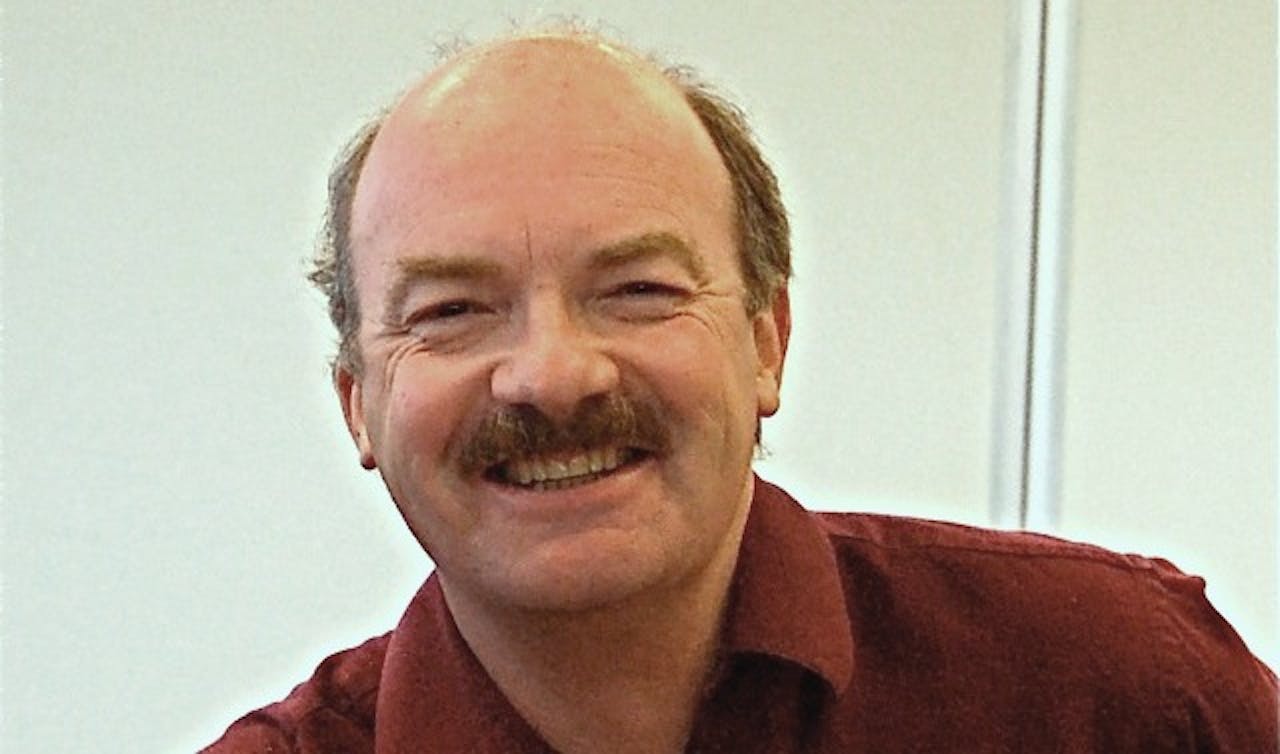

Amerikaans onderzoeker Ed Hovy gaf hier onlangs een goede aanzet toe, toen hij door Walter Daelemans was voorgedragen voor een eredoctoraat aan de Universiteit Antwerpen. Hij beschreef hoe een serie technieken, die bekend zijn in het vakgebied, gebruikt worden door veiligheidsdiensten om zo’n beetje alles te weten te kunnen komen over een willekeurig persoon. Misschien niet correct vanuit het oogpunt van privacy, maar wellicht noodzakelijk om het land te kunnen beschermen. Op basis hiervan stelde hij aan de zaal de vraag of dit een wenselijke gang van zaken is.

Met Eduard Hovy’s simpele technieken komen veiligheidsdiensten alles te weten van een willekeurig persoon.

Ed HovyDiscussie

We kwamen niet tot een duidelijke consensus rondom dit vraagstuk. Met openheid als hun belangrijkste wapen, kunnen wetenschappers in de taaltechnologie wel een bijdrage leveren aan de discussie. In reactie op de presentatie van Ed Hovy deed mijn begeleider Antal van den Bosch een interessante suggestie: we kunnen demo’s publiceren waarin we aan de samenleving laten zien wat op dit moment mogelijk is op het gebied van taaltechnologie. Prima als mensen aan de hand daarvan toch kiezen hun twittergedrag aan te passen.